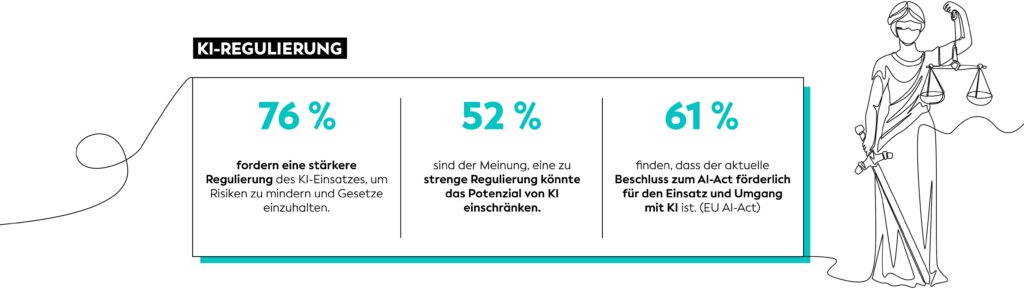

KI reglementieren, weil die Risiken der disruptiven Technologie sonst unabsehbar sind? Oder verlieren wir dadurch in Europa vorzeitig unsere Wettbewerbsfähigkeit gegenüber weniger reglementierten Ländern wie USA und China? Ein kontrovers diskutiertes Thema! Die Befragten unseres KI-Reports äußern sich deutlich: 76 % wollen eine KI-Regulierung. Allerdings: Gleichzeitig fürchten 52 %, dass dadurch das Potenzial der Technologie eingeschränkt würde.

Die wichtigsten Gründe für die Regulierung aus Sicht der Teilnehmenden sind:

- Gültige Gesetze einhalten

- Datenschutz und Urheberrecht sichern

- Ethische Aspekte wie die Diskriminierung durch verinnerlichte Vorurteile der Tools beachten

Im Zentrum der Debatte um KI-Regeln steht der EU AI Act

Der EU AI Act ist eine Regulierung der Europäischen Union, der einen rechtlichen Rahmen für den Einsatz und die Entwicklung von KI in Europa schafft. Ziel ist es, dass KI ethischen Standards entspricht, die Grundrechte schützt und Innovation fördert. Dazu klassifiziert der EU AI Act KI-Systeme anhand ihres Risikos in vier Kategorien mit entsprechenden Konsequenzen:

- Unannehmbares Risiko: Bestimmte Anwendungen von KI sind komplett verboten. Etwa KI-Systeme, die Menschen überwachen oder manipulieren.

- Hohes Risiko: KI-Anwendungen, die in Bereichen wie Medizin, Verkehr, Sicherheit oder Justiz eingesetzt werden, unterliegen strengen Vorschriften. Solche Systeme müssen hohe Anforderungen an Transparenz, Sicherheit, Datenschutz und Nachvollziehbarkeit erfüllen.

- Begrenztes Risiko: Hier geht es um KI-Systeme, die nicht direkt sicherheitskritisch sind, aber potenziell missbraucht werden könnten. Diese müssen Transparenzanforderungen erfüllen. Nutzende müssen beispielsweise informiert werden, wenn sie mit KI interagieren (z. B. Chatbots).

- Minimales Risiko: Für KI-Systeme mit geringem Risiko, wie etwa Spamfilter oder KI-gestützte Spiele, gibt es kaum bis keine regulatorischen Anforderungen.

Was das für Unternehmen bedeutet:

- Strenge Dokumentationspflichten: Unternehmen müssen umfassende Informationen über die Funktionsweise und Datenquellen der verwendeten KI-Tools bereithalten.

- Prüf- und Zertifizierungsprozesse: KI-Systeme mit hohem Risiko müssen zertifiziert werden. Ob die Vorschriften eingehalten werden? Zu prüfen!

- Kosten: Unternehmen müssen in die Erfüllung der regulatorischen Anforderungen investieren, insbesondere in Bereichen wie Risikobewertung, Datenschutz und Transparenz.

Vorteile:

- Vertrauen fördern: Durch den EU AI Act könnte das Vertrauen der Verbraucher und Geschäftspartner in KI-Anwendungen gestärkt werden, da diese sicherer und transparenter gestaltet werden.

- Wettbewerbsvorteil: Unternehmen, die sich frühzeitig auf die Vorschriften vorbereiten, können langfristig einen Wettbewerbsvorteil sichern. Denn sie können KI-Systeme anbieten, die den hohen europäischen Standards entsprechen. Dies könnte auch internationale Märkte beeinflussen. Denn Unternehmen außerhalb der EU, die in Europa aktiv sind, müssen die gleichen Standards erfüllen.

- KI ethisch entwickeln: Der EU AI Act sorgt dafür, dass KI-Systeme ethisch entwickelt werden. Sie sollen Menschenrechte und gesellschaftliche Werte beachten. So kann eine nachhaltige und verantwortungsvolle KI-Landschaft entstehen.

Kritik:

- Innovationen hemmen: Kritiker:innen befürchten, dass die strengen Auflagen Innovationsprozesse verlangsamen könnten. Der Grund: Unternehmen zögern möglicherweise, neue KI-Produkte auf den Markt zu bringen, bevor diese umfangreich geprüft und zertifiziert sind.

Wie geht es mit dem EU AI Act weiter?

Bei den Befragten des KI-Reports stößt der EU AI Act hauptsächlich auf Zustimmung: 61 % finden, dass der aktuelle Beschluss förderlich für den Einsatz und Umgang mit KI ist.

In Deutschland nimmt die Normungsroadmap KI die Details des EU AI Act in den Fokus. Ihre zweite Ausgabe erschien Ende 2022 (auch wir von SALT AND PEPPER wirkten daran mit). Sie ist eine aktualisierte Grundlage für Normen und Standards im Bereich Künstliche Intelligenz.

Zu den wesentlichen Themen gehören Transparenz, Sicherheit, Zertifizierung und die ethischen Aspekte von KI-Systemen. Aktuell überführen Expert:innen aus Wirtschaft, Wissenschaft und öffentlicher Hand in Normungsgremien und Forschungsprojekten die Ergebnisse der Roadmap in konkrete Normen und Standards. Das Ziel: KI-Regeln zügig implementieren, um die Wettbewerbsfähigkeit Deutschlands zu sichern.

Insgesamt haben seit Bestehen der Normungsroadmap KI mehr als 570 Fachleute aus verschiedenen Bereichen aktiv an dem Normierungsprojekt mitgewirkt. Wir sind überzeugt: Die Normung Künstlicher Intelligenz bildet einen enormen Meilenstein. Sie ist die Basis, um Rechtsvorschriften zu formulieren. Sobald bestimmte Kriterien definieren, ab wann ein System sicher und funktional ist, können auf dieser Grundlage Gesetze geschaffen werden. Besonders in sensibleren Bereichen, wie der Sicherheit und Gesundheit von Personen, ist das ein wichtiger Aspekt. Denn ist die KI-Sicherheit gewährleistet, kann sie auch in bis dato undenkbaren Bereichen eingesetzt werden. Etwa im Medizintechnikbereich und dort insbesondere im Hochrisikobereich der Medizinprodukteklassen IIa, IIb und III. Dort müssen für den Marktzugang hohe Zertifizierungshürden überwunden werden. Die Normung wird hier enorm viel erleichtern.

Die Umsetzung in der Praxis

Doch wie können sich Unternehmen auch abseits hoch spezialisierter Bereiche wie der Medizintechnik proaktiv auf den EU AI Act und die Normen und Gesetze aus der Normungsroadmap KI vorbereiten? Hier unsere Tipps:

- Compliance-Analyse durchführen: Überprüfen Sie Ihre bestehenden KI-Systeme: Stimmen sie mit den Anforderungen des EU AI Acts überein? Insbesondere hinsichtlich Risikoklassifizierungen und Transparenzanforderungen?

- Risikomanagement etablieren: Entwickeln Sie ein Risikomanagementsystem für KI-Anwendungen, das sich an den Vorgaben des EU AI Acts orientiert. Insbesondere zentral für Hochrisiko-KI-Systeme, die strengere Sicherheitsanforderungen erfüllen müssen.

- Normen und Standards verfolgen: Bleiben Sie über die News zur KI-Normungsroadmap informiert. Verfolgen Sie branchenspezifische Normen, die in Zukunft verpflichtend oder Best Practice werden könnten. Etwa in der industriellen Automation oder Medizin.

- Interne Prozesse anpassen: Integrieren Sie Anforderungen zu Transparenz, Ethik und Datenschutz in Ihre Entwicklungs- und Produktionsprozesse. So werden sie künftigen KI-Rules gerecht.

- Zertifizierung vorbereiten: Bereiten Sie sich auf mögliche Zertifizierungspflichten vor. Wie? Indem Sie etablieren oder challengen, wie Sie KI-Tools prüfen sowie zertifizieren. In der Normungsroadmap gibt es dazu Best Practices.

- Schulen und weiterbilden: Schulen Sie Ihre Mitarbeitenden über die neuen Anforderungen des EU AI Acts und der Normungsroadmap. Damit stärken Sie die internen Kompetenzen für den Einsatz konformer und sicherer KI-Lösungen.

- Extern zusammenarbeiten: Nehmen Sie an branchenübergreifenden Arbeitsgruppen teil. Oder kooperieren Sie mit Normungsgremien wie DIN oder DKE. Der Benefit: So stellen Sie sicher, dass Ihre Interessen in die Normen einfließen.

- Tech-Check: Implementieren Sie Mechanismen, um die Funktionsweise von KI-Systemen zu prüfen und zu dokumentieren. So stellen Sie sicher, dass alles transparent und nachvollziehbar abläuft.